如何辨别AI生成内容真假?GPT识别技术全解析

随着GPT-4o等AI语言模型的飞速发展,大量文本、图片、甚至音视频内容都可能是AI自动生成的。表面看不出破绽,真假难辨,也让我们陷入“AI真假信息焦虑”。那么,普通用户和内容审核平台该如何判断一段内容是否由AI生成?GPT模型能识别自己“写的内容”吗?

今天就带大家全面了解AI生成内容的识别方法与GPT识别技术的核心原理。

一、为什么需要识别AI生成内容?

AI生成内容本身并不危险,但如果被用于:

-

传播虚假信息(如伪造新闻、虚构人物发言)

-

刷量作弊(如自动写评论、生成答卷)

-

侵犯原创权利(模仿作者风格、生成仿写内容)

-

学术不端/考试作弊(AI代写论文/答题)

就可能对社会、教育、法律和平台生态造成巨大影响。因此,识别AI内容不仅是技术问题,更是安全和道德议题。

二、AI生成内容的常见特征

虽然GPT-4o文本生成能力非常自然,但仍有一些“可疑”特征可以作为参考:

-

语法完美但内容空泛:几乎无语病,但缺乏具体事实、细节模糊。

-

重复性高:部分句式或词语反复出现。

-

情绪中性:风格中规中矩,缺乏人类写作的情绪波动。

-

信息闭环:很少引用外部链接或资料来源。

-

过度逻辑性:每句话看似顺畅,缺乏人类那种偶尔跳脱的表达。

不过,仅凭这些表面特征并不足以做出100%判断。

三、主流AI内容识别技术解析

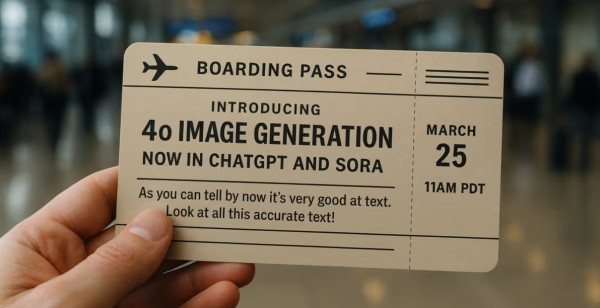

1. GPT自我识别技术(如OpenAI 提供的水印机制)

OpenAI 及其他机构正在研发的**“AI水印”技术**,会在生成内容中嵌入某种统计特征或隐形编码,比如:

-

特定的词频分布

-

模型输出概率的有意调整

-

不影响人类阅读却可被机器解读的“隐藏标记”

但目前该技术尚未大规模部署,尤其对普通用户来说不可见。

2. 第三方AI内容检测工具

一些工具利用机器学习模型对文本进行分析,比如:

-

OpenAI 的 AI Text Classifier(已下线)

-

ZeroGPT / GPTZero / Copyleaks:检测文本是否为AI生成,返回可信度评分。

-

Turnitin:针对学术写作,提供AI写作检测模块。

这些工具的准确率不一,适合辅助判断,但不能作为唯一依据。

3. 模型逆向推理

通过分析内容的生成方式,判断是否符合某类语言模型(如GPT-4o、Claude、Gemini)的“风格模板”:

-

大语言模型生成的内容往往呈现出“高度泛化”的表达方式

-

在特定主题(如科技、商业)下有相似用词习惯

这类方法通常需要大量样本训练和机器学习知识,属于专业平台或研究机构常用手段。

四、内容创作者与平台如何防范AI滥用?

-

明确标注AI内容来源:如果你用GPT-4o生成文章/内容,应在页脚或说明中标注“由AI协助生成”。

-

平台建立内容溯源机制:使用元数据、账号行为分析等,追踪AI内容流向。

-

结合人工审核:对于关键场景,如新闻、学术、法律类内容,AI识别工具+人工审核更稳妥。

五、总结

虽然GPT-4o等AI模型越来越“像人类”,但通过一定技术手段和经验分析,依然可以在很大程度上判断内容真伪。未来,随着AI识别水印、隐性标记等技术的成熟,判断AI内容将更智能、更可控。对普通用户来说,保持质疑精神+善用工具+合理标注,就是与AI共处的第一步。